Компю'терний кластер

| |

Дана стаття являється неперевіреним навчальним завданням.

До вказаного терміну стаття не повинна редагуватися іншими учасниками проекту. Після завершення терміну виконання будь-який учасник може вільно редагувати дану статтю і витерти дане попередження, що вводиться за допомогою шаблону. |

Кла́стер — це декілька незалежних обчислювальних машин, що використовуються спільно і працюють як одна система для вирішення тих чи інших задач, наприклад, для підвищення продуктивності, забезпечення надійності, спрощення адміністрування, тощо. Обчислювальний кластер потрібен для збільшення швидкості обрахунків за допомогою паралельних обчислень.

Зміст

Історія розвитку

Історія кластерів розпочалася 1994 році. Піонером у цій справі є науково–космічний центр NASA, точніше створений на його основі CESDIS (Center of Excellence in Space Data and Information Sciences). Фахівцями GSFC влітку 1994 року був зібраний перший кластер, що складався з 16 комп'ютерів 486DX4/100MHz/16Mb RAM і трьох паралельно працюючих 10Mbit мережевих адаптерів. Даний кластер, який був названий "Beowulf", створювався як обчислювальний ресурс проекту Eart and Space Sciences Project (ESS). Офіційна сторінка проекту Beowulf.

Через чотири роки в 1998 році, в Лос–Аламоської національній лабораторії (США) астрофізик Майкл Ворен та інші вчені з групи теоретичної астрофізики побудували суперкомп'ютер Avalon, який представляв собою кластер на базі процесорів Alpha 21164A з тактовою частотою 533 МГц. Спочатку Avalon складався з 68 процесорів, та згодом був розширений до 140. У кожному вузлі встановлено по 256 Мбайт оперативної пам'яті, жорсткий диск на 3 Гб і мережевий адаптер Fast Ethernet. Загальна вартість проекту Avalon склала 313 тисяч доларів, а показана ним продуктивність на тесті LINPACK – 47,7 GFLOPS, дозволила йому зайняти 114 місце в 12–й редакції списку Top500 поруч з 152–процесорною системою IBM RS/6000 SP. У тому ж 1998 році на найпрестижнішій конференції в області високопродуктивних обчислень Supercomputing'98 творці Avalon представили доповідь "Avalon: An Alpha / Linux Cluster Achieves 10 Gflops for $ 150k", що отримав першу премію в номінації "найкраще відношення ціна/продуктивність".

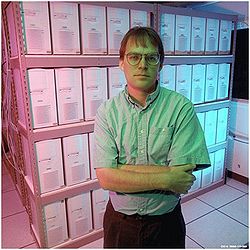

Цікава розробка з'явилася в Університеті штату Кентуккі – кластер KLAT2 (Kentucky Linux Athlon Testbed 2), зображений на рисунку 1.5. Система KLAT2 складається з 64 без дискових вузлів з процесорами AMD Athlon/700 Мгц і оперативною пам'яттю 128 Мбайт на кожному. Програмне забезпечення, компілятори і математичні бібліотеки (SCALAPACK, BLACS і ATLAS) були доопрацьовані для ефективного використання технології 3DNow! процесорів AMD, що дозволило збільшити продуктивність.

Оцінка ефективності роботи кластера

Деякі чисельні схеми в силу особливостей алгоритму не піддаються ефективному розпаралеленню. Перш ніж орієнтуватися на застосування кластера для вирішення задачі, необхідно впевнитися у можливості застосування паралельних алгоритмів.

Програма у паралельній архітектурі має створюватися з розрахунком на ефективне використання ресурсів цієї архітектури. Мається на увазі те, що застосування повинне бути розділене на частини, які можуть виконуватися паралельно на декількох процесорах, і розділене ефективно, щоб окремо виконувані шматки програми мінімально впливали на виконання інших частин.

Припустимо, що у програмі частка операцій, які потрібно виконувати послідовно, дорівнює f, де 0 <= f <= 1 (при цьому частка розуміється не по статичному числа рядків коду, а за кількістю операцій у процесі виконання). Крайні випадки в значеннях f відповідають повністю паралельним (f = 0) і повністю послідовним (f = 1) програмами. Так от, для того, щоб оцінити, яке прискорення S може бути отримано на комп'ютері з p процесорів при даному значенні f, можна скористатися законом Амдала:

[math]S \le {1 \over f + (1 - f)/p}[/math]

Припустимо, що у програмі лише 10% послідовних операцій, тобто f = 0.1. Можна зробити висновок, що скільки б процесорів не було використано, прискорення роботи програми більш, ніж у десять разів ніяк не буде отримано. І цифра 10 – це теоретична верхня оцінка найбільш оптимального випадку, коли ніяких інших негативних факторів немає.

Переваги та недоліки кластера

Переваги кластера

- Один

- Два

- Три

- Чотири

Недоліки кластера

- Один

- Два

- Три

Кластер ТНТУ

| Параметр | Серверний вузло | Клієнтський вузол |

|---|---|---|

| Частота процесора | 2 х 2,4 Гц | 2 х 2,13 Гц |

| Об'єм пам'яті | 4 Гб | 2 Гб |

| Жорсткий диск | 120 Гб | 40 Гб |

| Мережева карта | Intel® PRO/1000 | Intel® PRO/1000 |

| Інші пристрої | Клавіатура та миша | |