Відмінності між версіями «Ядерне згладжуваня»

Vova (обговорення • внесок) |

Vova (обговорення • внесок) (→Описание метода) |

||

| Рядок 17: | Рядок 17: | ||

Полученные таким образом веса далее используются для представления величины <math>a(x)</math> в виде взвешенной суммы значений <math> y_i</math> обучающей выборки. | Полученные таким образом веса далее используются для представления величины <math>a(x)</math> в виде взвешенной суммы значений <math> y_i</math> обучающей выборки. | ||

| − | == | + | == Опис методу == |

| − | === | + | === Визначення ядра === |

'''Ядро''' — это непрерывная ограниченная симметричная вещественная функция <math>K</math> с единичным интегралом | '''Ядро''' — это непрерывная ограниченная симметричная вещественная функция <math>K</math> с единичным интегралом | ||

::<math>\int K(u)du=1</math> | ::<math>\int K(u)du=1</math> | ||

| Рядок 30: | Рядок 30: | ||

представляет собой ядро с параметром <math>h_m</math>. Этот параметр принято называть шириной окна. Подчеркнув зависимость <math>h\ =\ h_m</math> от объема выборки <math>m</math>, условимся сокращенно обозначать последовательность весов <math>W_{mi}(x)</math>. | представляет собой ядро с параметром <math>h_m</math>. Этот параметр принято называть шириной окна. Подчеркнув зависимость <math>h\ =\ h_m</math> от объема выборки <math>m</math>, условимся сокращенно обозначать последовательность весов <math>W_{mi}(x)</math>. | ||

| − | === | + | === Функція ядра === |

Функция <math>\hat{f}_{h_m}(x)</math> является ''ядерной оценкой плотности Розенблата — Парзена'' (Rosenblatt, 1956; Parzen, 1962) для (маргинальной) плотности | Функция <math>\hat{f}_{h_m}(x)</math> является ''ядерной оценкой плотности Розенблата — Парзена'' (Rosenblatt, 1956; Parzen, 1962) для (маргинальной) плотности | ||

переменной <math>x</math>. Данный вид ядерных весов <math>W_{mi}(x)</math> был предложен в работах (Nadaraya, 1964) и (Watson, 1964). Как следствие, оценка | переменной <math>x</math>. Данный вид ядерных весов <math>W_{mi}(x)</math> был предложен в работах (Nadaraya, 1964) и (Watson, 1964). Как следствие, оценка | ||

| Рядок 42: | Рядок 42: | ||

'''Замечание'''. При ряде условий имеет место сходимость по вероятности данной оценки к <math>E(y|x)</math>. | '''Замечание'''. При ряде условий имеет место сходимость по вероятности данной оценки к <math>E(y|x)</math>. | ||

| − | === | + | === Приклад функції ядра === |

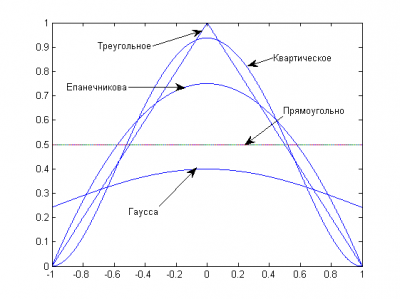

[[Файл:CoreFunc.png|thumb|right|400px|Приклади різних функцій ядра.]] | [[Файл:CoreFunc.png|thumb|right|400px|Приклади різних функцій ядра.]] | ||

| Рядок 62: | Рядок 62: | ||

Ядро определяет степень гладкости функции <math>a(x)</math>. | Ядро определяет степень гладкости функции <math>a(x)</math>. | ||

| − | === | + | === Залежність від ширини вікна === |

Выбор окна решающим образом влияет на точность восстанавливаемой зависимости. | Выбор окна решающим образом влияет на точность восстанавливаемой зависимости. | ||

При чересчур малых значениях <math>h</math> кривая <math>a(x)</math> стремится пройти через каждую точку выборки, остро реагируя на шумы и претерпевая резкие | При чересчур малых значениях <math>h</math> кривая <math>a(x)</math> стремится пройти через каждую точку выборки, остро реагируя на шумы и претерпевая резкие | ||

Версія за 19:19, 13 березня 2012

| |

Дана стаття являється неперевіреним навчальним завданням.

До вказаного терміну стаття не повинна редагуватися іншими учасниками проекту. Після завершення терміну виконання будь-який учасник може вільно редагувати дану статтю і витерти дане попередження, що вводиться за допомогою шаблону. |

| {{{img}}} | ||

| Імя | Володимир | |

| Прізвище | Шостак | |

| По-батькові | Михайлович | |

| Факультет | ФІС | |

| Група | СН-51 | |

| Залікова книжка | СН-11-222 | |

Ядерне згладжуваня - один із найпростіших видів непараметричної регресії.

Зміст

Постановка задачи

- Решается задача восстановления регрессии. Задано пространство объектов [math]X[/math] и множество возможных

ответов [math]Y=R[/math]. Существует неизвестная целевая зависимость [math]y^*: X \rightarrow Y[/math], значения которой известны только на объектах обучающей выборки [math]X^m={(x_i, y_i)}_{i=1}^m[/math]. Требуется построить алгоритм [math]a: X \rightarrow Y[/math], аппроксимирующий целевую зависимость [math]y^*[/math].

Принцип

Принцип, используйщий идейно простой подход к представлению последовательности весов [math]\{ W_{mi}(x) \}_{i=1}^m[/math] состоит в описании формы весовой функции [math]W_{mi}(x)[/math] посредством функции плотности со скалярным параметром, который регулирует размер и форму весов около х. Эту функцию формы принято называть ядром [math]K[/math].

Полученные таким образом веса далее используются для представления величины [math]a(x)[/math] в виде взвешенной суммы значений [math]y_i[/math] обучающей выборки.

Опис методу

Визначення ядра

Ядро — это непрерывная ограниченная симметричная вещественная функция [math]K[/math] с единичным интегралом

- [math]\int K(u)du=1[/math]

Последовательность весов

Последовательность весов для ядерных оценок (для одномерного [math]x[/math]) определяется как ::[math]W_{mi}(x)=\frac{K_{h_m}(x-X_i)}{\hat{f}_{h_m}(x)}[/math], где

- [math]\hat{f}_{h_m}(x)=\frac1m \sum_{i=1}^m K_{h_m}(x-X_i)[/math],

a

- [math]K_{h_m}(u)=\frac{1}{h_m} K\(\frac{u}{h_m}\)[/math]

представляет собой ядро с параметром [math]h_m[/math]. Этот параметр принято называть шириной окна. Подчеркнув зависимость [math]h\ =\ h_m[/math] от объема выборки [math]m[/math], условимся сокращенно обозначать последовательность весов [math]W_{mi}(x)[/math].

Функція ядра

Функция [math]\hat{f}_{h_m}(x)[/math] является ядерной оценкой плотности Розенблата — Парзена (Rosenblatt, 1956; Parzen, 1962) для (маргинальной) плотности переменной [math]x[/math]. Данный вид ядерных весов [math]W_{mi}(x)[/math] был предложен в работах (Nadaraya, 1964) и (Watson, 1964). Как следствие, оценка ожидаемой величины восстанавливаемой зависимости [math]E(y\|x)[/math]:

- [math]\hat{m}_h(x)=\frac{\frac1m\textstyle\sum\limits_{i=1}^m K_{h_m}(x-X_i)Y_i}{\frac1m\textstyle\sum\limits_{i=1}^m K_{h_m}(x-X_i)}[/math]

часто называют оценкой Надарая—Ватсона. Ширина окна определяет, насколько быстро убывают веса [math]W_{mi}(x)[/math] по мере удаления объектов [math]x_i[/math] от [math]x[/math]. Характер убывания определяется видом ядра [math]K[/math]. Нормализация весов [math]\hat{f}_{h_m}(x)[/math] гарантирует, что сумма весов равна единице.

Замечание. При ряде условий имеет место сходимость по вероятности данной оценки к [math]E(y|x)[/math].

Приклад функції ядра

На практике используется несколько видов ядерных функций. Чаще всего используется квартическая ядерная функция

- [math]K(u)=(15/16)(1-u^2)^2I(\| u \| \le 1)[/math].

Также используется ядро Епанечникова, обладающее некоторыми свойствами оптимальности [Хардле В п4.5]; это функция параболического типа (Epanechnikov, 1969; Bartlett, 1963):

- [math]K(u)=0.75(1-u^2)I(\| u \| \le 1)[/math].

Другими примерами являются ядро Гаусса,

- [math]K(u)=(2\pi)^{-1/2} \exp(-u^2/2)[/math],

треугольное ядро

- [math]K(u)=(1-\|u\|)I(\| u \| \le 1)[/math],

и прямоугольное ядро

- [math]K(u)=(1/2)I(\| u \| \le 1)[/math].

Замечание. Точность восстанавливаемой зависимости мало зависит от выбора ядра. Ядро определяет степень гладкости функции [math]a(x)[/math].

Залежність від ширини вікна

Выбор окна решающим образом влияет на точность восстанавливаемой зависимости. При чересчур малых значениях [math]h[/math] кривая [math]a(x)[/math] стремится пройти через каждую точку выборки, остро реагируя на шумы и претерпевая резкие скачки, поскольку в этом случае оценка опирается только на небольшое число наблюдений из узкой окрестности точки [math]x[/math]. Наоборот, если ширина окна велика, функция чрезмерно сглаживается и в пределе при [math]h \rightarrow \infty[/math] вырождается в константу -- усреднённое значение величин [math]y_i[/math]. В этом случае сглаженная функция не даёт возможности определить характерные особенности искомой зависимости [math]y^*(x)[/math].

Література

- Хардле В.Прикладна непараметрична регресія-1989р.

- Воронцов К.В.Лекції по алгоритмам відновлення регресії - 2007.

- Лагутин М.Б.Прикладна математична статистика.- 2009